Datensouveränität bezeichnet das Prinzip, dass digitale Informationen unter der gesetzlichen Verfügungsgewalt ihres Ursprungsortes oder ihrer Ursprungsgemeinschaft bleiben, wodurch die territoriale Souveränität auf die Online-Welt ausgedehnt wird. Ihre Durchsetzung hängt maßgeblich von der Cybersicherheit ab, denn obwohl in Gesetzen festgelegt sein kann, wo Daten gespeichert werden müssen und wer darauf zugreifen darf, können nur technische Systeme nachweisen, dass diese Grenzen auch eingehalten werden. Ohne Sicherheitsmaßnahmen lassen sich die rechtlichen Zusagen in der Praxis nur schwer überprüfen.

Verschlüsselung schützt Daten auf ihrem Weg, doch Datensouveränität sorgt für eine weitere Sicherheitsstufe: Die Schlüssel müssen unter lokaler Kontrolle bleiben. Über das Zugriffsmanagement wird die Identität mit dem geografischen Standort verknüpft. Dies stellt sicher, dass jemand, der sich aus dem Ausland einloggt, nicht auf Daten zugreifen kann, die durch lokale Gesetze geschützt sind. Segmentierte Netzwerke und lokalisierte Protokolle liefern den Regulierungsbehörden die von ihnen geforderten Nachweise: Wer hat von wo und unter wessen Aufsicht auf was zugegriffen?

In aktuellen Gesetzen sind diese Mechanismen als Verpflichtungen und nicht als Optionen definiert. Im Rahmen der in der EU geltenden Datenschutz-Grundverordnung (DSGVO) und der NIS2-Direktive, des chinesischen Datenschutzgesetzes (PIPL) oder der europäischen DORA-Verordnung für Finanzinstitute sind Sicherheitsmaßnahmen Bestandteil der rechtlichen Struktur. Ein Unternehmen, das Daten nicht gemäß diesen Standards schützt, ist nicht nur unsicher, sondern verstößt auch gegen die Vorschriften.

Per Gesetz kann die Verfügungsgewalt über die Daten festgelegt werden. Dies ist für sich gesehen schon ein umfangreiches Thema siehe diesen InfoZone-Artikel). Allerdings lässt sich diese Verfügungsgewalt nur durch Mechanismen der Cybersicherheit überprüfen. Zusammen sorgen diese beiden Aspekte für digitales Vertrauen, wobei der eine die Regeln festlegt, während der andere nachweist, dass diese funktionieren.

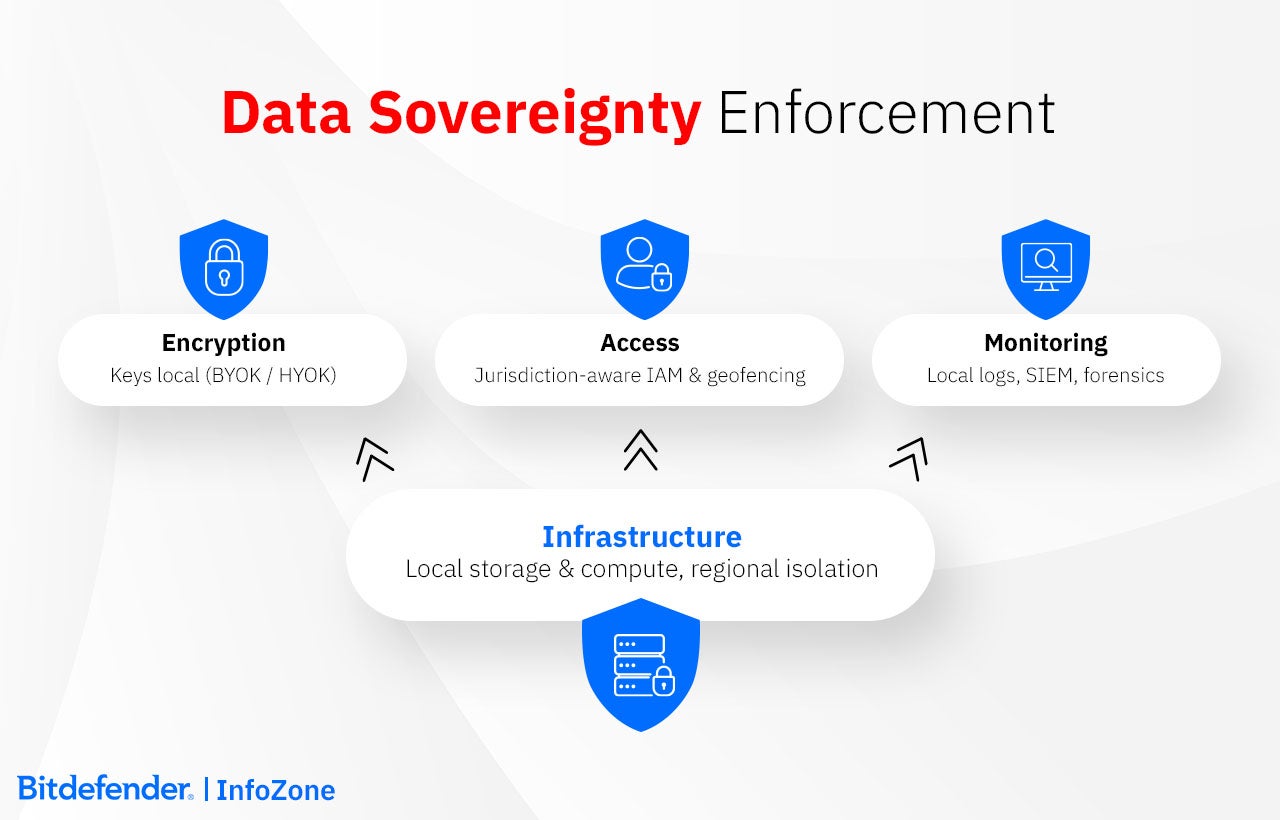

Datensouveränität ist nur möglich, wenn es wirksame Systeme zu ihrer Durchsetzung gibt. Das beginnt mit den rechtlichen Rahmenbedingungen, muss aber über deren Umsetzung in technische Maßnahmen fortgesetzt werden. Diese basieren auf konkreten Anforderungen, die damit zusammenhängen, wo die Daten gespeichert sind, wie sie geschützt werden, wer darauf zugreifen kann, wie Aktionen nachverfolgt werden usw. In der Praxis wird die Einhaltung der Vorschriften zum technischen Problem: Es muss eine Infrastruktur aufgebaut werden, in der die Grenzen des jeweiligen Rechtsraums von vornherein eingehalten werden.

Infrastruktur. Der Standort hat entscheidende Bedeutung für die Kontrolle. Daher muss im ersten Schritt ermittelt werden, wo sich die Daten befinden. Daraus folgt, dass die Infrastruktur sicherstellen muss, dass Speicherung und Verarbeitung der Daten innerhalb der zugelassenen Regionen erfolgen. Diese Beschränkungen müssen auch für Replikation und Backups gelten.

Verschlüsselung. In der nächsten Ebene entscheidet sich, wer die Daten freischalten kann. Damit jeglicher externe Zugriff unterbunden wird, darf niemand von außerhalb des betreffenden Rechtsraums in der Lage sein, verschlüsselte Daten zu entschlüsseln. Deshalb müssen die Verschlüsselungsschlüssel lokal aufbewahrt werden. Dies bedeutet aber auch, dass Daten, die ins Ausland übertragen werden müssen, dort unlesbar bleiben.

Zugriff. Die geografischen Beschränkungen gelten auch für die Menschen. Systeme für das Identitäts- und Zugriffsmanagement definieren, von wo aus sich die Benutzer anmelden und auf welche Daten sie zugreifen können. Sitzungsanfragen aus nicht zugelassenen Gebieten werden automatisch abgelehnt. Auf diese Weise gelten für die weltweit arbeitenden Mitarbeiter die lokalen Gesetze.

Überwachung. Die letzte Ebene weist nach, dass die anderen Ebenen funktionieren. Sicherheitsprotokolle und forensische Aufzeichnungen müssen lokal aufbewahrt bleiben, damit Beweismittel niemals eine Grenze überschreiten. Manchmal ist eine regionsübergreifende Analyse notwendig. In diesen Fällen empfiehlt es sich, abgeleitete Indikatoren (Zusammenfassungen) anstelle von Rohdaten zu verwenden.

Datensouveränität hängt zunächst einmal davon ab, wie die Infrastruktur aufgebaut und betrieben wird. Manche Unternehmen behalten die gesamte Workload vor Ort, um die volle rechtliche Kontrolle zu behalten. Andere nutzen Hybridmodelle, bei denen vertrauliche Daten lokal gehalten und die Daten weniger regulierter Prozesse in eine öffentliche Cloud verlagert werden. Cloud-Lösungen im jeweiligen Hoheitsgebiet erweitern dieses Konzept noch, indem sie sicherstellen, dass sowohl die Hardware als auch der Betrieb unter nationaler oder regionaler Kontrolle bleiben.

Auf technischer Ebene müssen Steuerungsebenen und Datenpfade innerhalb desselben Rechtsraums bleiben. Die Steuerungsebene dient zur Bereitstellung, Überwachung und Konfiguration; wenn sie sich in einem anderen Land befindet, werden selbst lokal gespeicherte Daten fremdbestimmt. Für alle Datenpfade (Speicherung, Replikation und Sicherung) müssen dieselben Regeln gelten, damit keine Kopie oder kein Telemetriedatenstrom die festgelegte Grenze verlassen kann.

Im operativen Betrieb stellt sich heraus, ob diese Grenzen eingehalten werden. Fernadministration, Patching und Überwachung dürfen nur durch verifiziertes inländisches Personal oder vertrauenswürdige, durch lokales Recht gebundene Partner erfolgen. Protokolle, Telemetriedaten und Backups sollten lokal weitergeleitet und gespeichert werden, wobei Failover-Systeme so einzurichten sind, dass eine Wiederherstellung der Daten innerhalb desselben Rechtsraums möglich ist.

Die Anbieter sichern die Plattform, aber die Kunden definieren ihre Grenzen, d. h. den Speicherort der Verschlüsselungsschlüssel, die Personen, die Zugriff auf die Systeme haben, und die Anbindung des externen Supports. Wenn Infrastruktur, Betriebsabläufe und vertragliche Kontrollmechanismen aufeinander abgestimmt sind, wird Datensouveränität messbar und existiert nicht nur auf dem Papier.

Sobald Daten über eine Grenze hinweg übertragen werden, muss jemand nachweisen, dass dies tatsächlich jedoch kein Grenzübertritt war. Dieser eine Widerspruch zieht sich durch jede technische Ebene der Datensouveränität, von den Verschlüsselungsschlüsseln bis hin zur Zugriffskontrolle. Für die Einhaltung von Vorschriften ist genau diese Art von Genauigkeit erforderlich. Und die Genauigkeit ist in der Praxis vielschichtig.

Mithilfe verschiedener Modelle lässt sich die Befugnis zur Entschlüsselung innerhalb der richtigen Grenzen halten. Hierzu gehören Bring Your Own Key (BYOK), Hold Your Own Key (HYOK) und die Client-seitige Verschlüsselung. Tatsächlich ist es jedoch schwieriger, die Kontrolle über die Schlüssel zu behalten, als die Daten selbst zu verschlüsseln. Aufbewahrung, Änderung und Ablauf der Schlüssel müssen innerhalb desselben Rechtsraums erfolgen, was durch regionale Audits überprüft wird. Für die Notfallwiederherstellung kommt eine weitere zu berücksichtigende Ebene hinzu: Backups, Failover-Systeme und wichtige Replikate müssen alle lokal gehalten werden. Die Kryptografie ist ausgereift genug, um die Daten wirksam zu schützen, aber ihre Umsetzung ist das erste Einfallstor.

Zugangsregeln, die anhand von geografischen Gegebenheiten definiert wurden, sehen auf dem Papier einfach aus, sind es aber selten. Dadurch, dass die Menschen reisen, Auftragnehmer wechseln und globale Unterstützungsmodelle zum Einsatz kommen, verwischen die klaren Grenzen der Datensouveränität. Um die Einhaltung aller Regeln zu gewährleisten, erzwingen einige Unternehmen Lesezugriff oder zeitlich begrenzte Sitzungen außerhalb zugelassener Regionen; andere gehen noch weiter und schotten ganze Datenumgebungen gegenüber der Außenwelt ab.

Bei der Überwachung müssen die kleinteiligen Ergebnisse zur besseren Nachvollziehbarkeit innerhalb der Landesgrenzen bleiben. Jeder Rechtsraum betreibt oft sein eigenes SIEM-System (Security Information and Event Management) und seine eigene forensische Umgebung, was den Export von Rohdatenprotokollen oder die gemeinsame Nutzung von Dashboards verhindert. Die Koordinierung hängt von abgeleiteten Indikatoren ab (Malware-Hashes, Angriffsmuster, anonymisierte Warnmeldungen), und nicht von vollständigen Telemetriedaten. Das funktioniert, dauert aber länger. Und schließlich gelten in jedem Land andere Regeln zur Meldung von Datenschutzverletzungen. Dies hat zur Folge, dass parallele Reaktionspläne durchgesetzt werden müssen, die für ein unterschiedliches Timing ausgelegt sind.

Heute geht es bei Compliance weniger um die Abgabe von Erklärungen, sondern vielmehr um Nachweise. Daher besteht zunehmend Bedarf an auditfähigen Systemen. Aus diesen muss hervorgehen, wo die Daten gespeichert sind, welche Personen darauf zugegriffen haben oder die Schlüssel besitzen.

Sicherheitsmodelle, die auf dem Zero-Trust-Prinzip basieren, stärken diesen Ansatz, indem sie den Zugriff auf verifizierte Benutzer beschränken und detaillierte Aufzeichnungen über jede Aktion erstellen.

Ein weiterer wichtiger Aspekt, den es zu beachten gilt: Alles muss innerhalb desselben Rechtsraums bleiben. Dies gilt für jeden nachzuweisenden Punkt (Standort, Schlüsselverwahrung, Personensicherheitsüberprüfung usw.). Somit nimmt der Audit-Trail selbst eine hoheitliche Stellung ein.

All das gibt es nicht zum Nulltarif. Der Betrieb paralleler Infrastrukturen, doppelter Überwachung und lokaler Teams führt zu einem erheblichen Mehraufwand, der oft als „Souveränitätssteuer“ bezeichnet wird. Es ist der Preis, der dafür gezahlt wird, dass sich die Kontrolle nachweisen lässt: höhere Komplexität im Austausch für Rechtssicherheit und digitales Vertrauen.

Datensouveränität ist im Grunde eine architekturbedingte Auflage. Das Ziel besteht darin, die Verfügungsgewalt im Code und in der Infrastruktur ohne Leistungseinbußen und exorbitante Kosten durchzusetzen. Das bedeutet, dass Muster ausgewählt werden müssen, die von vornherein Daten enthalten, und dann Steuerelemente einzubringen sind, mit denen dies nachgewiesen werden kann.

Örtliche Isolation ist die reinste Form der Kontrolle, bei der alle Daten-, Rechen- und Managementebenen innerhalb der Grenzen bleiben. Es ist einfach, dieses System den Regulierungsbehörden zu erklären, aber teuer in der Umsetzung: redundant ausgelegte Systeme, lokales Personal und eine Notfallwiederherstellung, die immer innerhalb der Region erfolgt. So erhält man Gewissheit mit dem Nachteil eines überdimensionierten Systems.

Eine föderierten Verschlüsselung stellt die kryptografische Kontrolle auch bei der Verschiebung von Workloads sicher. In der Praxis können Daten zwar zur Verarbeitung übertragen werden, die zu ihrer Entschlüsselung benötigten Schlüssel verlassen jedoch niemals ihren Rechtsraum. Dies ist ein praktisches Setup für verteilte Analysen oder das Training von Modellen, allerdings erhöhen sich die Kosten oft durch Koordinationsverzögerungen und zusätzliche Latenzzeiten.

Souveräne Cloud-Modelle bieten einen Mittelweg: regionale Steuerungsebenen und Datenpfade, standardisierte Steuerungsmechanismen und lokale Support-Teams. Ihr Vorteil besteht darin, dass sie mehr Agilität bieten als On-Premise-Umgebungen. Nachteilig ist allerdings, dass einige Fähigkeiten nicht mit globalen Diensten mithalten können.

Zero-Trust-IAM erzwingt die Klärung der Identität durch den Kontext. Wer den Zugriff anfordert, von wo aus, mit welchem Gerät und unter welchen Bedingungen – das sind nur einige der Faktoren, die dabei berücksichtigt werden. Administratorsitzungen, die außerhalb der zugelassenen Region eingeleitet werden, schlagen schlicht und ergreifend fehl.

Mit DLP-Tools (Data Loss Prevention) werden Schutzmechanismen hinzugefügt: Sie überprüfen und blockieren Daten während der Übertragung, wenn dabei gegen die Regeln des betreffenden Hoheitsgebiets verstoßen wird.

CIEM geht das gegenteilige Problem an: Es gibt zu viele Berechtigungen. Das System identifiziert ruhende oder zu weit gefasste Berechtigungen, die über verschiedene Rechtsräume hinwegreichen könnten.

Schließlich wird mit auf die Region zugeschnittenen SIEM- und Forensik-Systemen dafür gesorgt, dass die Überwachung lokal erfolgt. Wenn die Daten mitunter global korreliert werden müssen, werden abgeleitete Indikatoren anstelle der Rohdaten verwendet (diese könnten regulierte Daten offenlegen).

|

Bereich |

Zielsetzung |

Praktische Umsetzung |

|

Einhaltung eines hohen Standards |

Konsistente Kontrolle über alle Regionen hinweg behalten. |

Mit Policy-as-Code-Frameworks und CSPM-Tools kann überprüft werden, ob die Konfigurationen in jeder Region die strengsten geltenden Regeln einhalten. Ziel ist es, die strengste Vorgabe zum Standard und nicht zur Ausnahme zu machen. |

|

Lieferanten- und Unterauftragnehmer-Governance |

Verfügungsgewalt behalten, wenn die Kontrolle nicht mehr bei Ihnen liegt. |

Verlangen Sie von den Anbietern einen überprüfbaren Nachweis (z. B. SecNumCloud-, ISO 27001- oder SOC 2 Typ II-Zertifizierungen), und lassen Sie sich über APIs oder Dashboards bestätigen, wo Replikate und Backups tatsächlich gespeichert sind. Diese Überprüfungen sind wichtiger als Vertragsklauseln. |

|

Risiko- und Resilienztests |

Decken Sie Schwächen auf, bevor sie vom Auditor gefunden werden. |

Führen Sie anhand der Souveränitätsrisiken Resilienzübungen durch: Was passiert, wenn eine Region offline geht oder ein im Ausland befindlicher Administrator sich versehentlich verbindet? Simulieren Sie solche Fälle. Protokollierung, Ausfallsicherung und Reaktion auf Sicherheitsvorfälle müssen alle innerhalb des richtigen Rechtsraums funktionieren. |

|

Technologien zur Verbesserung des Datenschutzes (PETs) |

Analysen unterstützen und gleichzeitig die Rohdaten vor Ort halten. |

Nutzen Sie Verfahren wie föderiertes Lernen, sichere Berechnung in umgebungsübergreifenden Systemen oder vertrauenswürdige Ausführungsumgebungen (TEEs), damit die Daten lokal bleiben, während die daraus gewonnenen Erkenntnisse übertragen werden. Passen Sie das Verfahren an die Workload an, da sich vollständig lokale, hybride oder souveräne Cloud-Setups jeweils unterschiedlich verhalten. |

|

Schlüsselverwaltung und Kryptografie |

Die Kontrolle über die kryptografischen Verfahren muss innerhalb des Hoheitsgebiets bleiben. |

Implementieren Sie BYOK, HYOK oder clientseitige Verschlüsselung mit lokalen HSMs (Hardware-Sicherheitsmodulen) oder einem auf die Region beschränkten KMS (Schlüsselverwaltungsdienst). Generierung, Speicherung und Wechsel von Schlüsseln müssen innerhalb derselben Region erfolgen. Dokumentieren Sie die Schlüsselverwahrung und die Aufgabentrennung zwischen Anbieter und Nutzer. |

|

Zuständigkeitsbezogenes Identitäts- und Zugriffsmanagement (IAM) |

Sorgen Sie dafür, dass der Zugriff sich nach dem geografischen Standort und dem rechtlichen Geltungsbereich richtet. |

Wenden Sie standortbezogene Zugriffsrichtlinien und Netzwerksegmentierung an, um administrative Aktionen anhand der Region einzuschränken. Integrieren Sie eine kontinuierliche Verifizierung mithilfe von Zero-Trust-Identitätsmodellen, um Grenzfälle hinsichtlich der Mitarbeiter zu steuern. |

|

Lokal gespeicherte Protokolle und Compliance |

Souveränität muss durch Nachweise, nicht durch Erklärungen belegt werden. |

Protokolle, Telemetriedaten und forensische Daten sollten lokal gespeichert werden. Wenn eine globale Korrelation erforderlich ist, verwenden Sie abgeleitete Indikatoren, nicht die Rohdaten selbst. Erstellen Sie Audit-Aufzeichnungen für Datenstandort, Schlüsselverwaltung und Sicherheitsüberprüfungen des Personals. |

|

Härtung und Überwachung (PHASR) |

Angriffsfläche bei souverän verarbeiteten Workloads verringern. |

Nutzen Sie PHASR-Maßnahmen (Proactive Hardening and Attack Surface Reduction), um nicht erforderliche Administrator-Tools zu deaktivieren, berechtigt durchgeführte Sitzungen eng zu überwachen und die Steuerelemente dynamisch anhand des Systemverhaltens und nicht statischer Richtlinien anzupassen. |

Ein einzelner Sicherheitsvorfall kann sich schneller über Grenzen hinweg auswirken, als Teams sich abstimmen können. Wenn das geschieht, besteht die Herausforderung nicht nur darin, den Angriff zu stoppen, sondern auch darin, zu verstehen, welche Gesetze nun für die betreffenden Daten gelten. Ein auf die Datensouveränität abgestimmter Reaktionsplan berücksichtigt, dass Eindämmung und Einhaltung der Vorschriften Hand in Hand gehen müssen.

Vorbereitung

Eine gute Vorbereitung bedeutet oft, im Vorfeld unsichtbare Arbeit zu leisten: Überprüfen, welche Gesetze für die vorhandenen Daten gelten, außerdem feststellen, welche davon die Frist in Gang setzen, wie beispielsweise die 72-Stunden-Regel der DSGVO.

Im Falle einer Sicherheitsverletzung wissen die Teams bereits, wen sie kontaktieren müssen (z. B. lokale Anwälte, Forensik, PR-Kontakte) und verlieren so weniger Zeit bei der Suche nach Unterstützung.

Dabei zählen auch Kleinigkeiten: eine sofort übersetzbare Mitteilung kann viel Zeit sparen, wenn mehrere Behörden sofortige Antworten verlangen.

Erkennung und Eindämmung

Sobald eine Warnmeldung ausgegeben wird, stellt sich die Frage: Wo befinden sich die Daten, und welche Bürger sind betroffen? Die Eindämmung hängt davon ab, dass die betreffenden rechtlichen Grenzen eingehalten werden.

Der Einsatz von regionalen Überwachungs- oder XDR- Tools hilft den Ermittlern, die Übertragung der Daten einzuschränken und die Analyse zu koordinieren, ohne dass dabei Protokolle oder Nachweise ins Ausland exportiert werden.

Was geschieht nach dem Sicherheitsvorfall?

Nach der Sicherheitsverletzung wird Datensouveränität zur Nachweisfrage. Die Nachweise müssen den rechtlichen Standards des jeweiligen Rechtsraums entsprechen, und bei Nachkontrollen mit den Behörden muss bestätigt werden, dass die Eindämmung und die Wiederherstellung innerhalb der lokalen Grenzen erfolgen konnten. Teams, die technische Erkenntnisse aus dem Vorfall mit einer juristischen Einsatznachbesprechung verbinden, sind oft besser auf das nächste grenzüberschreitende Ereignis vorbereitet.

Datensouveränität scheitert selten innerhalb des Unternehmens, sondern meist durch das Versagen anderer. Anbieter, Cloud-Partner und SaaS-Anbieter erweitern alle denselben rechtlichen Rahmen, unabhängig davon, ob sie sich dessen bewusst sind oder nicht. Wenn die Daten sich außerhalb der internen Kontrolle befinden, gilt das nicht für die Verantwortlichkeit; sie verbleibt beim ursprünglichen Dateneigentümer.

Gefährdung durch Dritte

Schwachpunkte hinsichtlich der Datensouveränität verbergen sich oft im Geschäftsbetrieb von externen Anbietern. Ein Anbieter verspricht möglicherweise lokales Hosting, speichert aber die Backups im Ausland oder erlaubt den Helpdesk-Zugriff aus einer anderen Region. Dieser Fernzugriff kann ausreichen, um die Daten dem Recht eines anderen Landes zu unterstellen, beispielsweise dem CLOUD Act der USA. Schatten-IT verschlimmert die Situation noch weiter: Nicht zugelassene Anwendungen oder SaaS-Tools verschieben unbemerkt regulierte Daten in Clouds, die niemand überwacht.

Bedrohungen über die Lieferkette

Angreifer haben gelernt, dass es einfacher ist, über die Lieferkette einzudringen als das Ziel direkt anzugreifen. Die Kompromittierung eines einzigen Anbieters kann viele Kunden gleichzeitig gefährden, wie der SolarWinds-Vorfall deutlich gezeigt hat. Im Ausland befindliche Administratoren oder Subunternehmer mit uneingeschränktem Zugriff schaffen ähnliche blinde Flecken und erweitern so den Rechtsraum effektiv über das hinaus, was in den Verträgen vorgesehen war.

Im europäischen Finanzsektor ist die sicherste Regel ganz einfach: Nichts darf die EU verlassen. Diese Bank betreibt ihre gesamte Workload ausschließlich auf EU-Infrastruktur: primäre Systeme, Backups, sogar Test- und Bereitstellungsumgebungen. Die Verschlüsselungsschlüssel werden lokal generiert und über Bring-Your-Own-Key-Tresore unter direkter Kontrolle des Compliance-Teams gewechselt.

In den Sicherheitsabteilungen wird ein regionales SIEM-System verwendet, das niemals Roh-Protokolldaten exportiert, sondern nur abgeleitete Warnmeldungen. Bei den Übungen startet ein Countdown mit der Meldung „Sicherheitsverletzung festgestellt“ und endet vor Ablauf von 72 Stunden, wodurch sichergestellt werden soll, dass die Compliance-Fristen unter realen Bedingungen getestet werden. Bei den jährlichen Audits wird vor allem bestätigt, dass jedes Byte an Kundendaten bis zu seinem physischen Speicherort zurückverfolgt werden kann. Das Ergebnis ist zwar nicht gerade beeindruckend, aber es ist vertretbar, und das ist für die Regulierungsbehörden am wichtigsten.

Für ein in den USA ansässiges Finanzunternehmen, das Daten europäischer Kunden verarbeitet, bestehen Risiken hinsichtlich der Datensouveränität in beide Richtungen. Der CLOUD Act erlaubt es US-Behörden, Daten von amerikanischen Anbietern anzufordern, unabhängig davon, wo sich diese Daten befinden – dies gilt auch für die EU. Die DSGVO geht in die entgegengesetzte Richtung: Sie verbietet Datentransfers in Länder ohne entsprechende Schutzmaßnahmen.

Damit das Unternehmen nicht in einen Zwiespalt gerät, führt es seine Europa betreffenden Aktivitäten innerhalb lokaler Cloud-Regionen durch und verwahrt seine Verschlüsselungsschlüssel innerhalb der EU. Der Zugriff wird über ein auf den jeweiligen Rechtsraum abgestimmtes IAM-System verwaltet: Es schränkt ein, wer personenbezogene Rohdaten einsehen kann und von wo aus. Sicherheitsprotokolle bleiben lokal gespeichert, lediglich aggregierte Indikatoren werden global zur Bedrohungskorrelation weitergegeben.

Durch diese Maßnahmen werden die rechtlichen Spannungen zwar nicht beseitigt, aber das Unternehmen erhält den Nachweis, dass EU-Daten auch unter US-amerikanischer Eigentümerschaft weiterhin auf gleiche Weise geschützt sind – ein Gleichgewicht, das von den Regulierungsbehörden zunehmend als praktischer Standard akzeptiert wird.

Für einen multinationalen Entwickler, der den chinesischen Markt bedient, wird durch die Netzwerkarchitektur eine harte Grenze gezogen. Server, Schlüssel, Telemetriefunktionalität – alles befindet sich in inländischen Einrichtungen. Die Verschlüsselung erfolgt nach dem Prinzip „Hold-Your-Own-Key“: Das Unternehmen speichert seine Schlüssel getrennt von der Host-Umgebung, sodass selbst der Infrastrukturanbieter die Daten nicht ohne lokale Genehmigung entschlüsseln kann.

Die Teams, die mit Sicherheitsüberwachung und Vorfallsreaktion betraut sind, arbeiten ausschließlich im Inland; der Fernzugriff aus dem Ausland ist physisch über ein Gateway blockiert.

Das Unternehmen muss sich jedes Jahr einer staatlichen Sicherheitsprüfung unterziehen, um nachzuweisen, dass seine Datenflüsse niemals das nationale Hoheitsgebiet verlassen. Auch wenn es sehr teuer ist, parallel ein globales und ein nationales System zu pflegen, so ist dies die einzige Möglichkeit, sicherzustellen, dass sich das Unternehmen gesetzeskonform verhält.

Nicht jedes Projekt kann auf das Gebiet innerhalb einer Landesgrenze beschränkt sein. In Forschungs- und Produktionsnetzwerken, die sich über Kontinente erstrecken, nutzen die Teilnehmer Datenräume, die auf dezentralem Vertrauen basieren. Jedes Unternehmen behält seine Daten dort, wo sie entstanden sind; die Datenverarbeitung wird verlagert, nicht der Inhalt. Richtliniendefinierte Konnektoren legen fest, wer welchen Datensatz zu welchem Zweck abfragen darf, wodurch Nutzungsrechte in Echtzeit durchgesetzt werden. Der Zugriff erfolgt über Konnektoren, die die Richtlinien in Echtzeit überprüfen: Wer darf welche Daten abfragen und warum? Die Daten selbst bleiben an Ort und Stelle; was übertragen wird, sind anonymisierte Ergebnisse oder trainierte Modelle. Lokale Auditoren sind für ihre jeweiligen Umgebungen zuständig und gewährleisten so die Einhaltung regionaler Vorschriften auch innerhalb globaler Projekte. Diese Vorgehensweise ist nicht perfekt, funktioniert aber besser, als Mauern zu bauen.

Aktuell gängige KI-Modelle benötigen Skalierbarkeit und Diversität, um sich weiterentwickeln zu können. Andererseits ziehen Datenschutzgesetze Grenzen und hemmen die Vielfalt. In der Praxis liefert ein zentralisiertes KI-Training zwar Genauigkeit, verstößt aber gegen die Lokalisierungsregeln. Es ist nicht notwendig, dass das gesamte Training an einem Ort stattfindet. Manche Teams teilen den Prozess mittlerweile komplett auf: lokales Training, Austausch komprimierter Gradienten über verschlüsselte Kanäle und anschließendes erneutes Training, um Verzerrungen auszugleichen, die dadurch entstehen, dass jede Region nur ihre eigenen Daten sieht.

Ein weiterer Ansatz besteht darin, dass die Länder geschlossene Forschungsnetzwerke einrichten, die wie Miniatur-Internets funktionieren. Dies ist ein Kompromiss, damit die Modelle innerhalb ihrer Grenzen lernen und gleichzeitig globalen Trends folgen können.

Die meisten Experten sind sich nach wie vor einig, dass Quantencomputer die Verschlüsselung nicht schon morgen knacken werden. Das bedeutet aber nicht, dass die Planung für eine Zukunft mit Quantencomputern nicht schon begonnen hat.

Heute entwendete Daten könnten vielleicht erst in zehn Jahren entschlüsselt werden. Als Verteidigungsmaßnahmen kommen Migration und hybride Kryptographie infrage, bei der klassische und quantensichere Algorithmen kombiniert werden, wobei die neuen NIST-Standards als Leitlinie dienen.

Was geschieht, wenn wenige Anbieter zu viel Kontrolle über die Infrastruktur erlangen? Die Gefahr besteht darin, dass die Kontrolle der Verfügungsgewalt lediglich auf dem Papier steht. Abhängigkeiten verbergen sich in Update-Servern, Support-Kanälen und Subunternehmern, die niemand genau zuordnen kann.

Risikominderung bedeutet Vielfalt: Teilen Sie Workloads auf, wechseln Sie Lieferanten und überprüfen Sie die verborgenen Ebenen der Lieferkette.

Europas neue Regeln verlagern die Resilienz vom Papier hin zu realen Tests. Red-Team-, Wiederherstellungs- und Vorfallsübungen sind nicht mehr optional, sondern werden erwartet. Dadurch muss bewiesen werden, dass die Systeme auch bei Grenzschließungen oder dem Ausfall von Anbietern eigenständig funktionieren können. Der gleiche Druck breitet sich auch an anderer Stelle aus. Viele Unternehmen verlassen sich heute auf globale Standards wie SOC 2 und ISO 27001, um nachzuweisen, dass ihre Sicherheitsmaßnahmen tatsächlich funktionieren. Diese Frameworks wurden nicht für die Datensouveränität entwickelt, doch ihre Fokussierung auf Nachweisen und wiederholbaren Tests passt zu der von DORA und NIS2 vorgegebenen Richtung. Zusammen stehen sie für einen Wandel: Sicherheit ist inzwischen messbar, und nicht nur als Erklärung vorhanden.

Mit Bitdefender GravityZone ist Datensouveränität nicht mehr nur eine politische Richtlinie, sondern lässt sich technisch nachweisen. Die Plattform basiert auf einer in der EU betriebenen, eigenständigen Cloud-Infrastruktur und integriert die notwendigen Kontrollmechanismen, um jede Durchsetzungsebene (Infrastruktur, Verschlüsselung, Zugriff und Überwachung) zu sichern, über die eine überprüfbare souveräne Architektur definiert wird.

Auf der Infrastrukturebene befinden sich mit GravityZone on Sovereign Cloud Infrastructures (secunet / SysEleven und OVHcloud) Speicher, Telemetrie und Verwaltung innerhalb zugelassener Regionen. Das System ist auf lokale Steuerung und Resilienz ausgelegt und erfüllt die praktischen Anforderungen von DORA und NIS2. Durch diese Konfiguration wird sichergestellt, dass die Daten bei der Verarbeitung, der Analyse und sogar beim routinemäßigen Support unter der Rechtshoheit der EU bleiben.

Um den Datenresidenz- und Schutzanforderungen gerecht zu werden, verwendet Bitdefender mehrschichtige Sicherheitsvorkehrungen sowohl für gespeicherte Daten als auch für die Systemintegrität. Full Disk Encryption (FDE) schützt die Daten auf Endpoints und umfasst eine zentrale Schlüsselverwaltung sowie Compliance-Berichte. Integrity Monitoring blickt über die Dateien hinaus und untersucht die Aspekte, die häufig Probleme verursachen: Änderungen in der Registrierung, Anwendungen oder Benutzerkonten. Diese werden kontinuierlich überwacht, und jegliches anormale Verhalten wird gemeldet.

In der Praxis wird die Datensouveränität häufig im Bezug auf die Zugriffssteuerung getestet. CSPM+ (Cloud Security Posture Management) überwacht die Cloud-Konfigurationen und prüft sie anhand interner und externer Compliance-Regeln. In das System ist CIEM (Cloud Infrastructure Entitlement Management) integriert. Dadurch wird noch eine zusätzliche, präzisere Ebene hinzugefügt, die Berechtigungen einschränkt, damit Konten im Laufe der Zeit nicht übermäßig viele Zugriffsrechte ansammeln.

Identity Threat Detection and Response (ITDR) konzentriert sich auf den Missbrauch von Zugangsdaten und das Erkennen von Mustern, die auf das Vordringen im internen Netzwerk oder eine Ausweitung von Benutzerrechten hindeuten. Proactive Hardening and Attack Surface Reduction (PHASR) schließt dann die verbleibenden Schwachstellen, deaktiviert nicht verwendete Tools und verschärft automatisch die Berechtigungen.

Wenn etwas durchgerutscht ist, muss die Eindämmung schnell und lokal erfolgen. Bitdefender XDR und EDR führen Signale von Endpoints, Netzwerken, Identitäten und Cloud-Workloads zusammen und wandeln sie in einen einzigen Untersuchungspfad um. Analysten können die gesamte Sequenz über die Ursachenanalyse nachvollziehen und den Kontext über die Funktionen Vorfalluntersuchung und Forensik sofort einsehen.

Für Unternehmen, die eine 24/7-Überwachung ihrer Infrastruktur benötigen, bietet Managed Detection and Response (MDR) eine kontinuierliche Überwachung durch Menschen und die Eindämmung von Bedrohungen in Echtzeit durch die globalen Security Operations Centers von Bitdefender, darunter ein großes SOC mit Sitz in Rumänien innerhalb der Europäischen Union.

Offensive Security Services, einschließlich Penetration Testing und Red Teaming, bestätigen, dass souveräne Architekturen bei realen Angriffsbedingungen standhalten und die Anforderungen an Resilienztests gemäß DORA und NIS2 erfüllen.

Wenn von souveränen Daten die Rede ist, sind damit Informationen gemeint, die ein Land, eine Gemeinschaft oder eine andere Autorität als unter ihrer eigenen Verfügungsgewalt und ihrem eigenen Schutz stehend beansprucht. Dies bedeutet, dass die Daten als Teil des betreffenden Rechtsraums betrachtet werden, selbst wenn sie sich auf einem ausländischen Cloud-Server befinden oder von einem Unternehmen im Ausland verarbeitet werden.

Meistens handelt es sich dabei um einige bekannte Arten: personenbezogene Daten von Bürgern oder Einwohnern; vertrauliche Geschäftsdaten oder medizinische Informationen; und das, was Regierungen als kritische Daten bezeichnen, wie zum Beispiel Verteidigungsdossiers, Aufzeichnungen zur Infrastruktur oder Daten von Energiesystemen. Einige Staaten schließen hierbei auch geistiges Eigentum oder Forschungsergebnisse mit ein, wenn diese mit der nationalen Sicherheit oder dem öffentlichen Interesse in Zusammenhang stehen.

Dieser Gedanke ist auch nicht auf einzelne Staaten beschränkt. Indigene Gemeinschaften verwenden den Begriff, um die Kontrolle über die Daten zu behaupten, die sich auf ihr Volk, ihr Land und ihre Traditionen beziehen.

Das allein reicht nicht aus. Durch Datensouveränität wird festgelegt, wessen Gesetze für Ihre Daten gelten, aber sie hindert niemanden daran, ein schwaches Passwort oder einen ungepatchten Server für einen Angriff auszunutzen. Organisationen werden so allerdings gezwungen, die richtigen Schutzmaßnahmen zu ergreifen. Man kann es sich wie ein Regelwerk vorstellen, das Sicherheit gesetzlich verpflichtend macht und nicht nur als bewährte Vorgehensweise empfiehlt.

Bei den meisten Souveränitätssystemen ist eine Verschlüsselung verpflichtend; das gleiche gilt für die Kontrolle über die eigenen Schlüssel. Selbst wenn Daten gestohlen werden, bedeutet dies, dass sie ohne lokale Genehmigung nutzlos sind. Für den Zugriff müssen zudem Regeln gelten, die den Rechtsraum berücksichtigen: Nur sicherheitsüberprüfte Personen im jeweiligen Land dürfen auf bestimmte Systeme zugreifen. Dadurch wird die Eindringtiefe eines Angreifers beschränkt. Eine lokale Überwachung und Protokollierung beschleunigen die Erkennung – eine weitere Anforderung an die Datensouveränität, die gleichzeitig eine gute Sicherheitsmaßnahme darstellt.

Die Souveränität verändert die Lage vor allem hinsichtlich der Verantwortlichkeit. Eine Sicherheitsverletzung in einer souveränen Umgebung ist nicht nur ein technisches Versagen, sondern ein regulatorisches. Die Strafen beim Verlust der Kontrolle über geschützte Daten sind erheblich.

Sovereign Compute bezeichnet üblicherweise den Gedanken, dass Daten in demselben Rechtsraum verarbeitet werden sollten, in dem sie gespeichert und verwaltet werden. In der Praxis bedeutet das, dass die Server, Workloads und Supportteams, die mit vertraulichen Informationen arbeiten, alle innerhalb eines einzigen Rechtsraums operieren und nicht über verschiedene Regionen auf der Welt verstreut sind. Ziel ist es, nicht nur die Datenspeicherung, sondern auch die Datenverarbeitung in lokaler Hand zu halten.

Die Vorgehensweise ist sehr unterschiedlich. Einige Unternehmen führen Workloads auf privater oder staatlich kontrollierter Infrastruktur aus; andere nutzen „souveräne Cloud“-Umgebungen, bei denen Management und Support innerhalb nationaler Grenzen eingegrenzt sind. Auch Hybridansätze sind üblich, bei denen regulierte Workloads lokal verarbeitet werden, während Routineprozesse in kommerziellen Clouds laufen.

Die eigentliche Spannung liegt im Kompromiss. Cloud-Plattformen sind dafür ausgelegt, Workloads dorthin zu verlagern, wo sie sinnvoll, schneller, kostengünstiger und effizienter abgearbeitet werden können, doch die Datensouveränität verlangt das Gegenteil. In der Praxis führt das dazu, dass jedes Team letztendlich seine eigene Grenze zwischen Compliance und Performance zieht und die Workloads manchmal eher nach dem Gesetz als nach den Benutzern ausrichtet.